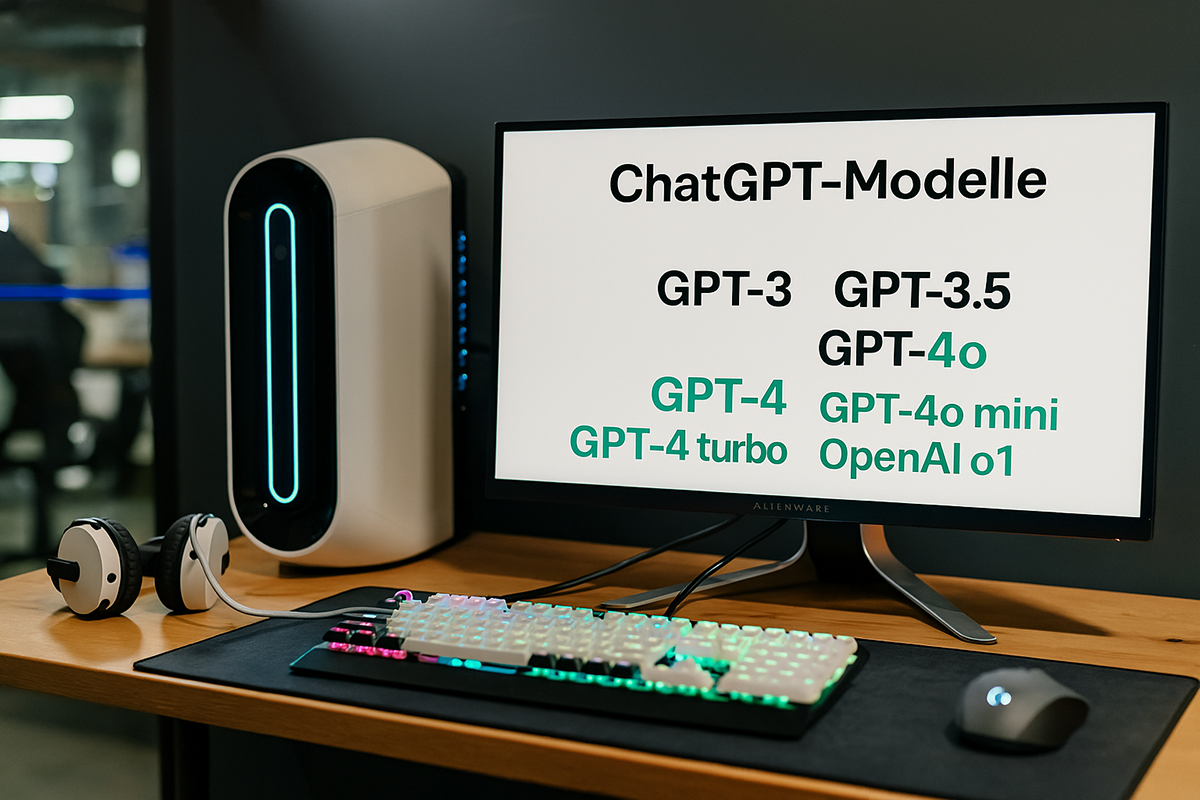

Künstliche Intelligenz (KI) ist aus der heutigen Geschäftswelt nicht mehr wegzudenken. Insbesondere die ChatGPT-Modelle von OpenAI haben seit ihrem Erscheinen 2022 (als ChatGPT auf Basis von GPT-3.5) einen rasanten Aufstieg in Unternehmen erlebt. Ob im Kundenservice, Marketing oder zur Entscheidungsfindung – immer häufiger unterstützen KI-Textmodelle Unternehmer dabei, effizienter zu arbeiten und innovative Lösungen zu finden. Mittlerweile bietet OpenAI mehrere neue ChatGPT-Modelle mit unterschiedlichen Stärken an. Dieser Beitrag beleuchtet sachlich-journalistisch die derzeit verfügbaren Modelle – GPT-4.5, GPT-4o, GPT-4o mini, OpenAI o1 und o1-mini – und zeigt auf, welche Bedeutung und Einsatzmöglichkeiten sie für Unternehmer haben.

Grundlagen: Tokens, Kosten und Modell-Entwicklung

Bevor wir in die Details der Modelle eintauchen, lohnt sich ein Blick auf ein paar grundlegende Konzepte. Tokens sind die Recheneinheiten, nach denen Text-KI abgerechnet wird. Ein Token entspricht ungefähr 4 Zeichen oder 0,75 Wörtern in englischem Text. Für eine grobe Einordnung: 100 Tokens entsprechen etwa 75 Wörtern, ein typischer Satz umfasst ~30 Tokens, ein längerer Absatz ~100 Tokens. Für die Nutzung der Modelle – sei es über das ChatGPT-Webinterface oder über die Programmierschnittstelle (API) – spielt die Anzahl der verarbeiteten Tokens eine zentrale Rolle bei der Kostenstruktur. OpenAI berechnet die Kosten pro 1.000 oder pro 1 Million Tokens, getrennt nach Eingabe (Prompt) und Ausgabe (generierter Text).

Dabei gilt: Je leistungsfähiger das Modell, desto höher in der Regel der Preis. So liegen die API-Kosten für das neueste Top-Modell GPT-4.5 bei etwa 0,07 € pro 1.000 Eingabetokens und 0,14 € pro 1.000 Ausgabetokens (ca. $75 bzw. $150 pro 1 Mio. Tokens). Zum Vergleich kostet das etwas ältere Multimodal-Modell GPT-4o nur rund 0,0025 € bzw. 0,01 € pro 1.000 Tokens ($2,50/$10 pro Mio.) – wir sehen also drastisch unterschiedliche Preisstufen. OpenAI bietet die Modelle nicht nur über die API, sondern auch in Abo-Plänen an: ChatGPT Plus (ca. 20 $ ~ 18 € pro Monat) ermöglicht z.B. eine begrenzte Nutzung fortgeschrittener Modelle in der Chat-Oberfläche, während ChatGPT Pro (~200 $ mtl.) fast unbegrenzten Zugang und exklusive Modelle bietet. Für Unternehmen gibt es zudem Enterprise-Tarife, die höhere Limits und Datenkontrolle bieten.

Unterschiede zu früheren Modellen: Die aktuellen GPT-4-basierten Modelle haben gegenüber früheren Versionen wie GPT-3.5 (dem ursprünglichen ChatGPT) erhebliche Fortschritte gemacht. Sie besitzen weitaus größere Kontextfenster (bis zu 128.000 Tokens, früher oft nur 4k–16k) und können somit sehr lange Dokumente oder Gespräche verarbeiten. Außerdem wurde die Wissensbasis aktualisiert – statt eines Wissensstandes von 2021 (GPT-3.5) nutzen Modelle wie GPT-4o Daten bis Oktober 2023. Einige Modelle sind multimodal, d.h. sie können neben reinem Text auch Bilder und Audio verarbeiten oder sogar generieren. Die Fehleranfälligkeit (Halluzinationen) wurde bei den neuesten Modellen weiter reduziert, und die Antwortqualität – ob fachliche Korrektheit oder stilistische Nuancierung – hat sich deutlich gesteigert. Gleichzeitig sind einige Modelle viel kostengünstiger in der Nutzung geworden, was insbesondere für Startups und KMUs attraktiv ist. Im nächsten Abschnitt stellen wir die einzelnen aktuellen Modelle im Detail vor, erklären ihre technischen Fähigkeiten, Vor- und Nachteile, Preise und geben Beispiele, wofür Unternehmer sie ideal einsetzen können.

Detaillierte Vorstellung der Modelle

GPT-4.5 – Das Flaggschiffmodell

Technische Fähigkeiten: GPT-4.5 ist OpenAIs aktuell leistungsstärkstes Sprachmodell (Codename „Orion“), veröffentlicht Ende Februar 2025. Es baut auf der GPT-4-Reihe auf und wurde durch groß angelegtes unüberwachtes Training und Feintuning weiter skaliert. Das Resultat ist ein Modell mit enormer Sprachgewandtheit, einem breiten Wissensschatz und außergewöhnlicher Fähigkeit, Anweisungen zu befolgen. GPT-4.5 versteht subtile Eingaben und Kontextnuancen sehr gut und reagiert in einem natürlich wirkenden, konversationsfähigen Stil. Besonders kreative und anspruchsvolle Aufgaben – z.B. stilsicheres Schreiben, komplexe Analysen oder mehrsprachige Kommunikation – meistert es mit Bravour. Erste Tests zeigen, dass Interaktionen mit GPT-4.5 „noch natürlicher“ wirken und es über breiteres Weltwissen verfügt als frühere Modelle. Zudem halluziniert es deutlich seltener, liefert also faktengenauere Auskünfte. Im direkten Vergleich übertrifft GPT-4.5 sein Vorgängermodell GPT-4o in allgemeinen Wissensfragen und sogar in 15 verschiedenen Sprachen deutlich.

Vorteile & Schwächen: Der größte Vorteil von GPT-4.5 ist seine Qualität: Für nahezu jede Aufgabe liefert es die bestmöglichen Ergebnisse in Bezug auf Korrektheit, Detailtiefe und sprachliche Feinheit. Es ist auch sehr vielseitig – von kreativen Texten bis zu Programmierhilfe – und unterstützt alle neuen ChatGPT-Tools (z.B. Bilder einlesen, Funktionen aufrufen). Allerdings hat GPT-4.5 auch Nachteile: Es ist gewaltig groß und „denkt“ nicht explizit schrittweise nach. Tatsächlich verzichtet dieses Modell bewusst auf das neue Chain-of-Thought-Reasoning der o-Serie und setzt stattdessen auf sein enormes implizites Wissen. Das bedeutet, für logische Schritt-für-Schritt-Probleme (z.B. komplexe Rechenaufgaben mit vielen Zwischenschritten) ist es weniger optimiert – hier können die spezialisierten O-Modelle besser sein. Außerdem ist GPT-4.5 sehr rechenintensiv, was zu etwas langsameren Antwortzeiten führen kann. Multimodale Ausgaben wie direkte Audio- oder Videogenerierung beherrscht es nicht (wohl aber Bildeingaben und die Erzeugung von Grafiken via DALL-E). Für einfache Aufgaben wäre sein Einsatz „mit Kanonen auf Spatzen geschossen“ – hier lohnt der Blick auf kleinere Modelle.

Aktuelle Preise: Qualität hat ihren Preis – GPT-4.5 ist das mit Abstand teuerste Modell. Über die API kostet es rund 70 € pro 1 Mio. Eingabetokens und 140 € pro 1 Mio. Ausgabetokens (zum Vergleich: GPT-4o liegt bei ca. 2,50 €/10 €). In der ChatGPT-Oberfläche ist GPT-4.5 derzeit nur für zahlende Nutzer verfügbar (Plus-/Pro-Abonnenten sowie Enterprise). ChatGPT-Plus-Nutzer können GPT-4.5 im Modellmenü auswählen, unterliegen aber möglicherweise Limits in der Anzahl der Nachrichten pro Zeiteinheit. Pro-Abonnenten (ca. 185 € mtl.) erhalten großzügigere Kontingente. Für viele Unternehmer dürfte GPT-4.5 aufgrund der Kosten eher punktuell (für wichtige Aufgaben) zum Einsatz kommen.

Ideale Anwendungsbereiche: GPT-4.5 eignet sich für Szenarien, in denen höchste Qualität und Präzision gefragt sind. Zum Beispiel:

-

Strategische Texte & Recherchen: Verfassen von umfangreichen Geschäftsplänen, Marktanalysen oder Whitepapern, bei denen Faktenrecherche und stilsichere Formulierung entscheidend sind. GPT-4.5 halluziniert weniger und liefert verlässliche Faktenbasis, was etwa beim Erstellen eines Investment-Pitches hilfreich ist.

-

Kreative Kampagnen: Entwicklung von Slogans, Werbetexten oder Markenstorys, die originelle Ideen erfordern. Durch die erweiterte Kreativität des Modells können Unternehmer einzigartige Marketinginhalte generieren lassen.

-

Komplexe Datenanalyse & Übersetzungen: Analysieren großer Daten- oder Dokumentenmengen im Prompt (Dank großem Kontextfenster), z.B. juristische Verträge oder Finanzberichte zusammenfassen. Auch mehrsprachige Kommunikation – etwa das Übersetzen eines Geschäftsangebots in mehrere Sprachen – meistert GPT-4.5 mit hoher Zuverlässigkeit.

GPT-4o – Der multimodale Allrounder

Technische Fähigkeiten: GPT-4o (das „o“ steht für omni) ist ein im Mai 2024 veröffentlichtes Modell der GPT-4-Familie. Es handelt sich um ein mehrsprachiges, multimodales KI-Modell, das Text, Bilder und Audio verarbeiten und generieren kann. GPT-4o war OpenAIs erster großer Schritt, Bildgenerierung direkt in ein Sprachmodell zu integrieren – es verfügt über einen eingebauten Bildgenerator, der äußerst präzise und fotorealistische Grafiken erstellen kann. Ebenso kann GPT-4o Bildinhalte verstehen (ähnlich wie GPT-4 Vision) und sogar Audio ausgeben: In ChatGPT wurden etwa verschiedene KI-Stimmen angeboten, mit denen GPT-4o Antworten vorlesen konnte. Kurz: GPT-4o ist nativ multimodal und vereint Sprach- und Bilder-KI in einem System. Die Sprachkompetenz von GPT-4o liegt deutlich über GPT-3.5 und etwa auf Augenhöhe mit dem frühen GPT-4, inkl. verbessertem Weltwissen bis 10/2023. Es kann komplexe Eingaben analysieren, mehrstufige Anfragen bearbeiten und liefert in den meisten Fällen sachliche und flüssige Antworten. Mit einem Kontextfenster von bis zu 128k Tokens kann GPT-4o sehr lange Eingaben verarbeiten – praktisch, um z.B. ganze Bücher oder Datensätze zu durchforsten.

Vorteile & Schwächen: Als Vielseitigkeitschampion bietet GPT-4o Unternehmen die Möglichkeit, Text- und Bildaufgaben in einem Tool zu bündeln. Ein großer Vorteil ist die Integration von Bildgenerierung: So lassen sich etwa Marketing-Bilder, Produktgrafiken oder Diagramme per Textbefehl erstellen, ohne ein separates Grafik-KI-Modul bemühen zu müssen. Auch die Sprachausgabe macht GPT-4o interessant – z.B. könnten Unternehmer mit GPT-4o Prototypen für Sprachassistenten oder automatische Kunden-Hotlines entwickeln (das Modell antwortet mit natürlicher Stimme). In puncto Rechengeschwindigkeit ist GPT-4o sehr effizient; es verarbeitet Anfragen schneller als die ursprüngliche GPT-4-Version. Zudem ist es deutlich günstiger als GPT-4.5 (siehe Preise unten), was hohe Aufrufzahlen erschwinglich macht. Schwächen zeigt GPT-4o im Vergleich zum neuen GPT-4.5 vor allem bei der faktischen Genauigkeit in speziellen Fällen. Es neigt etwas eher zu Fehlern oder vereinfachten Annahmen (Halluzinationen), gerade bei seltenen Fakten oder kniffligen Wissensfragen – OpenAI verbesserte diese Aspekte erst mit GPT-4.5 merklich. Auch die ganz extreme Problemlöse-Fähigkeit erreicht GPT-4o nicht; für kniffligste logische oder mathematische Herausforderungen reichen seine “Denkfähigkeiten” nicht an die der o1-Serie heran. Nichtsdestotrotz ist GPT-4o für die meisten Alltagsanwendungen bereits äußerst leistungsfähig.

Aktuelle Preise: GPT-4o zeichnet sich durch ein hervorragendes Preis-Leistungs-Verhältnis aus. OpenAI hat die API-Preise im Vergleich zu GPT-4 drastisch gesenkt: Eingabetext kostet ca. 2,30 € pro 1 Mio. Tokens, Ausgabe ca. 9,20 € pro 1 Mio. Tokens. Zum Launch wurde GPT-4o sogar allen Nutzern kostenfrei zugänglich gemacht (mit limitierten täglichen Anfragen), während ChatGPT-Plus-Abonnenten höhere Nutzungslimits erhielten. Inzwischen ist GPT-4o integraler Bestandteil von ChatGPT – zahlende Nutzer können es unbegrenzt verwenden, und für Gratis-Nutzer steht es in begrenztem Umfang oder in der kleineren Mini-Variante (s.u.) zur Verfügung. Für Unternehmer heißt das: Hochwertige KI-Ausgaben zu geringen variablen Kosten. Wer etwa einen Chatbot mit vielen Nutzeranfragen betreibt, kann mit GPT-4o für einen Bruchteil der früher üblichen Kosten skalieren.

Ideale Anwendungsbereiche: GPT-4o passt immer dann, wenn breite KI-Fähigkeiten benötigt werden, aber keine extremen Spezialfälle vorliegen. Zum Beispiel:

-

Kundenservice und Chatbots: GPT-4o kann in Chatbots integriert werden, um Kundenanfragen auf Webseiten oder in Apps zu beantworten – inklusive Verständnis von einfachen Bildschirmfotos oder Screenshots, die ein Kunde hochlädt. Durch die niedrigen Kosten pro Interaktion bleiben die Ausgaben auch bei hohem Volumen tragbar.

-

Content-Erstellung mit Bildunterstützung: Marketing-Teams können GPT-4o nutzen, um Blogartikel oder Social-Media-Posts inkl. passender Bilder zu generieren. Etwa eine Produktbeschreibung schreiben und gleich ein Produktbild oder Info-Graphik erstellen lassen – alles in einem Rutsch mit demselben Modell.

-

Analysen und Zusammenfassungen: Dank großem Kontextfenster eignet sich GPT-4o, um z.B. umfangreiche Umfragen oder Berichte zu analysieren. Ein Unternehmer könnte dem Modell einen Berg an Kundenfeedback (Texte, Tabellen) geben und erhält eine strukturierte Auswertung. Bei Bedarf könnten sogar Fotos (z.B. von Produktmängeln) mit einbezogen werden, da GPT-4o Bildinhalte versteht.

GPT-4o mini – Der schnelle Sparfuchs

Technische Fähigkeiten: GPT-4o mini ist die kleinere Ausgabe von GPT-4o, die OpenAI im Juli 2024 vorgestellt hat. Mit geschätzten 8 Milliarden Parametern ist das Modell wesentlich kompakter, was zu geringeren Rechenanforderungen führt. Trotz der Reduktion bleibt GPT-4o mini multimodal und erstaunlich kompetent – OpenAI gibt an, dass es die Fähigkeiten von GPT-3.5 Turbo übertrifft, jedoch zu einem Bruchteil von dessen Kosten. Tatsächlich wurde GPT-4o mini in der ChatGPT-Oberfläche schnell zum neuen Standard: Es ersetzte das alte GPT-3.5 als Default-Modell für kostenlose Nutzer und schont dabei die Serverressourcen. GPT-4o mini kann wie sein großer Bruder sowohl Text als auch Bilder (und in begrenztem Umfang Audio) verarbeiten. Allerdings ist seine Wissensbasis und sein Sprachverständnis etwas begrenzter – außerhalb häufig trainierter Bereiche fällt die Genauigkeit etwas ab, und es kann schneller zu Halluzinationen kommen, wenn sehr spezielles Fachwissen gefragt ist. Im Kern ist GPT-4o mini optimiert für Alltagsdialoge und gängige Aufgaben: es antwortet flott, klar und angemessen, ohne dabei allzu sehr ins Detail zu gehen.

Vorteile & Schwächen: Der größte Trumpf von GPT-4o mini ist die Effizienz. Es ist enorm schnell und vor allem unschlagbar günstig. Für Unternehmen und Entwickler, die viele API-Anfragen stellen oder einen breiten Kundenstamm bedienen, bedeutet dieses Modell drastisch geringere Kosten bei immer noch solider Leistung. OpenAI selbst betonte, dass die niedrigen Kosten speziell für Startups und Entwickler interessant sind, die große Anfragevolumina haben. Ein weiterer Vorteil: Durch die geringere Komplexität ist GPT-4o mini weniger anfällig für lange Denkpfade – es liefert schnelle, einfache Antworten, was für unkomplizierte Aufgaben effizienter sein kann als ein großes Modell, das vielleicht „überlegt“. Auf der Kehrseite steht, dass GPT-4o mini nicht die gleiche Tiefe wie größere Modelle erreicht. Bei komplexen logischen Problemen, sehr kreativen Aufgaben oder umfangreichen Analysen stößt es schneller an Grenzen. Auch sein Kontextfenster ist mit 128k zwar identisch zu GPT-4o, aber die maximale Ausgabelänge wurde meines Wissens nach eher um ~16k Tokens beschränkt, was aber für die meisten Anwendungen ausreicht. Insgesamt kann man GPT-4o mini als Arbeitstier für Routinejobs betrachten – kosteneffizient und zuverlässig genug für Standardaufgaben, jedoch nicht das schärfste Werkzeug für Spezialfälle.

Aktuelle Preise: Hier zeigt sich der Vorteil besonders deutlich. GPT-4o mini ist extrem preisgünstig. Die API-Tarife liegen bei ungefähr 0,14 € pro 1 Mio. Eingabetokens und 0,55 € pro 1 Mio. Ausgabetokens. Anders ausgedrückt: 1.000 Token Ausgabe (rund 750 Wörter Text) kosten nicht einmal 1 Cent! Selbst wenn man das Modell auf eigene Branchen-Daten feinjustiert (Fine-Tuning), bleiben die Kosten sehr niedrig – laut OpenAI verdoppeln sich in dem Fall die Tokenpreise lediglich. Für ChatGPT-Nutzer ist GPT-4o mini kostenlos zugänglich und wird automatisch verwendet, falls man kein anderes Modell wählt oder das Kontingent von GPT-4o ausgeschöpft ist. Diese Preisstruktur macht GPT-4o mini zum idealen Einstiegsmodell für Unternehmer, die KI ausprobieren oder in großem Stil automatisieren möchten, ohne hohe Rechnungen zu riskieren.

Ideale Anwendungsbereiche: GPT-4o mini glänzt überall dort, wo hohes Volumen an eher einfachen Aufgaben anfällt. Einige Beispiele:

-

E-Mail-Automatisierung: Ob tägliche Kundenanfragen, Terminvereinbarungen oder interne Memos – GPT-4o mini kann standardisierte E-Mails und Antworten formulieren, sodass ein kleines Unternehmen täglich Dutzende Mails automatisch vorformulieren lässt. Menschen prüfen nur noch kurz und versenden. Die Kosten bleiben dabei verschwindend gering, selbst bei tausenden Mails im Monat.

-

Content in Serie: Ein Startup möchte z.B. für jeden seiner 500 Artikel im Onlineshop eine Kurzbeschreibung generieren oder Produktbewertungen zusammenfassen. GPT-4o mini kann diese Massentexte effizient erstellen. Auch Social-Media-Posts „am Fließband“ zu produzieren (z.B. tägliche Tweets aus einem Katalog von Fakten) lässt sich so sehr günstig umsetzen.

-

Einfache Datenanalyse: Für Aufgaben wie das Auswerten von Feedback-Kommentaren, das Extrahieren von Schlüsselwörtern oder Kategorisieren von Support-Tickets reicht GPT-4o mini oft aus. Unternehmer können das Modell z.B. nutzen, um hunderte Kundenkommentare in „positiv/negativ“ zu sortieren oder häufig genannte Themen herauszufiltern – in Sekunden und fast kostenfrei.

OpenAI o1 – Das Denker-Modell für komplexe Probleme

Technische Fähigkeiten: OpenAI o1 (häufig nur o1-preview genannt) markiert eine neue Modellreihe, die im September 2024 als Preview eingeführt wurde. Anders als die GPT-4o-Modelle, die primär auf breite Wissensfragen und flüssige Konversation trainiert sind, wurde o1 speziell darauf ausgelegt, mehr Zeit mit „Nachdenken“ zu verbringen, bevor es antwortet. Das o1-Modell nutzt intern Techniken des Chain-of-Thought-Reasonings: Es lernt, komplexe Aufgaben Schritt für Schritt zu durchdenken, verschiedene Lösungsansätze auszuprobieren und auch eigene Fehler zu erkennen. Dadurch kann o1 erheblich schwierigere Probleme lösen – insbesondere in naturwissenschaftlichen Fächern, beim Programmieren und in der Mathematik. In Tests löste das erste o1-Modell beispielsweise Mathematik-Olympiade-Aufgaben in 83% der Fälle korrekt, während GPT-4o nur auf 13% kam. Ähnlich beeindruckend sind seine Coding-Skills: In Programmierwettbewerben (Codeforces) erreichte o1 das Niveau der oberen 11%. Diese Zahlen verdeutlichen, dass o1 ein echter Spezialist für hochkomplexe Herausforderungen ist. Das Modell kann umfangreiche Codeblöcke verstehen und schreiben, schwierige mathematische Beweise führen oder wissenschaftliche Analysen durchführen, bei denen es systematisches Durchdenken braucht. Das Kontextfenster ist – wie bei GPT-4o – sehr groß (128k Tokens), und o1 kann Ausgaben bis zu 32k Tokens Länge erzeugen, was z.B. ausführliche Berechnungswege ermöglicht.

Vorteile & Schwächen: Der klare Vorteil von OpenAI o1 liegt in seiner überragenden Problemlösungskompetenz. Für Unternehmer, die in forschungsnahen Bereichen oder der Softwareentwicklung tätig sind, kann dieses Modell Aufgaben bewältigen, an denen andere KI-Modelle scheitern. Es ist ideal, um mehrstufige Projekte durchzugehen – sei es ein komplexer Algorithmus, den es zu schreiben gilt, oder eine wissenschaftliche Hypothese, die es Schritt für Schritt zu prüfen gilt. o1 „reflektiert“ förmlich bei der Arbeit und erzielt dadurch in STEM-Aufgaben (Science, Technology, Engineering, Math) die höchste Ergebnisqualität aller OpenAI-Modelle. Darüber hinaus legt OpenAI bei der o1-Serie großen Wert auf Safety: Durch das deliberate Vorgehen sollen unbedachte Fehloutputs reduziert werden, was die Zuverlässigkeit erhöht.

Nachteilig ist bei o1 die Geschwindigkeit – all dieses extra „Nachdenken“ kostet natürlich Rechenzeit. Im Vergleich zu GPT-4o, das blitzschnell reagiert, benötigt o1 deutlich länger, um eine Antwort zu formulieren (Latenz teils >20 Sekunden). Für einen einfachen Chat ist das mitunter zu langsam. Hinzu kommt, dass o1 nicht ganz so „gesprächig“ und kreativ ist; außerhalb seiner Kerndomänen (z.B. bei Alltagswissen, Smalltalk oder kreativen Texten) liefert es Outputs, die eher den älteren GPT-4-Level erreichen und nicht besser sind. Man könnte sagen: o1 ist ein Top-Experte in seinem Fach, aber kein vielseitiger Plauderer. Außerdem ist o1 derzeit noch relativ neu/experimentell – bei der Einführung war es nur als Preview mit begrenzten Nutzungsraten verfügbar, und es fehlen (noch) einige Features wie Web-Browsing oder Dateiupload, die ChatGPT sonst bietet. OpenAI arbeitet jedoch daran, diese Funktionen nachzurüsten, um o1 in Zukunft noch praktischer einsetzbar zu machen.

Aktuelle Preise: Die o1-Modelle sind in der Nutzung teurer als GPT-4o, aber immer noch günstiger als GPT-4.5. Für die API wird für o1-preview etwa 14 € pro 1 Mio. Eingabetokens und 55 € pro 1 Mio. Ausgabetokens fällig (ca. $15/$60). Damit kostet eine Anfrage mit 1.000 ausgegebenen Tokens rund 0,055 € – durchaus verkraftbar, wenn man bedenkt, welche komplexen Aufgaben dafür gelöst werden. OpenAI positioniert o1 allerdings eher als Premium-Modell: Beim Start bekamen Plus- und Team-Abonnenten lediglich 30 Nachrichten pro Woche mit o1 kostenlos. Inzwischen dürften diese Limits gestiegen sein, und Enterprise-Nutzer haben vollen Zugriff. Für Entwickler war o1-preview anfangs nur ab hohen API-Tiers nutzbar. Man kann davon ausgehen, dass o1 perspektivisch auch breiter verfügbar wird. Die kleinere Version o1-mini (s.u.) ist deutlich günstiger, falls Kosten ein Engpass sind. Zudem hat OpenAI angekündigt, die o-Serie kontinuierlich weiterzuentwickeln, was vermutlich auch zu Preisanpassungen führen wird.

Ideale Anwendungsbereiche: OpenAI o1 kommt dort zur Geltung, wo reine Rechenpower auf schwierige Fragen trifft. Einige Anwendungsideen für Unternehmer:

-

Softwareentwicklung und Debugging: Für Tech-Startups oder IT-Abteilungen kann o1 wie ein Senior-Entwickler agieren. Man kann einen großen Codebase oder einen algorithmischen Entwurf an das Modell geben, und o1 wird gründlich nachdenken, Fehler finden und sogar Korrekturen vorschlagen. Ein Nutzerbericht beschreibt etwa, wie o1-mini einen 1000-Zeilen-Code analysierte und binnen Minuten einen kniffligen Bug löste, an dem ein Entwickler stundenlang verzweifelt war. Solche Fähigkeiten können die Produktentwicklung dramatisch beschleunigen.

-

Wissenschaftliche Analyse & F&E: Unternehmen in Bereichen wie Biotech, Chemie oder Ingenieurwesen können o1 zur Auswertung komplexer Daten nutzen. Beispielsweise könnten Forscher in der Medizin o1 einsetzen, um Genomdaten zu annotieren oder Studienergebnisse logisch herzuleiten. Physiker könnten das Modell schwierige Formelableitungen in der Quantenoptik durchrechnen lassen. Hier spielt o1 seine Stärken in Mathematik und logischem Denken voll aus.

-

Planung komplexer Geschäftsentscheidungen: Selbst in nicht-technischen Bereichen könnte ein Unternehmer o1 als eine Art „Planungsberater“ für komplexe Probleme nutzen. Etwa bei einer mehrstufigen Expansionsstrategie mit vielen Variablen (Marktdaten, Finanzkennzahlen, rechtliche Bedingungen) kann o1 helfen, verschiedene Szenarien durchzudenken und strukturiert Vor- und Nachteile abzuwägen – quasi eine Simulation komplexer Entscheidungspfade.

OpenAI o1-mini – Günstige Logik für den Alltag

Technische Fähigkeiten: Zeitgleich mit o1-preview brachte OpenAI auch eine abgespeckte Version o1-mini heraus. Dieses Modell behält die Kernidee des ausgedehnten Reasonings bei, wurde aber auf weniger Parameter verkleinert und speziell im MINT-Bereich (Mathematik, Informatik, Naturwissenschaft, Technik) optimiert. o1-mini ist besonders gut in Aufgaben rund ums Programmieren – OpenAI nennt explizit das generieren und debuggen von Code als Stärke. Im Gegenzug verfügt o1-mini über etwas weniger Allgemeinwissen abseits von STEM-Themen. In fachfremden Gebieten (z.B. Geschichte, allgemeine Trivia) erreicht es eher das Niveau von GPT-4o mini, während es in seinem Spezialgebiet Logik/Coding glänzt. Bemerkenswert ist, dass o1-mini trotz kleinerer Größe einen höheren maximalen Output (bis 64k Tokens) hat – es kann also sogar längere Lösungswege am Stück ausgeben als das große o1, bevor es ans Limit stößt. Die Geschwindigkeit von o1-mini ist ebenfalls besser: Es generiert Tokens schneller als o1 und hat mit ca. 9 Sekunden mittlerer Latenz zwar immer noch spürbare Verzögerung, aber nur etwa halb so lang wie das große Modell. Damit wird o1-mini für die Praxis schon deutlich nutzerfreundlicher.

Vorteile & Schwächen: Der Vorteil von o1-mini liegt klar in der Kombination aus Denkleistung und Kostenersparnis. Es bietet vielen der logischen Superkräfte von o1, aber zu geringeren Kosten und mit flotterer Reaktion. Für Unternehmen, die insbesondere Coding-Aufgaben automatisieren möchten – z.B. automatisierte Code-Reviews, Generierung von Routinefunktionen oder Ausbesserung von Bugfixes – ist o1-mini ein äußerst attraktives Modell. Es wurde dafür designt, Entwicklern ein günstiges Werkzeug an die Hand zu geben, das trotzdem korrekt und durchdacht antwortet. Schwächen zeigt o1-mini, ähnlich wie o1, außerhalb seines Kerngebiets: Es ist kein Alleskönner für kreative Inhalte oder breite Nutzerinteraktion. Zudem ist es nach wie vor experimentell; es fehlten anfangs Features wie der systemische Umgang mit aktuellen Web-Infos oder Dateiuploads, was jedoch nach und nach ergänzt wird. Insgesamt kann man o1-mini als Spezial-Werkzeug ansehen – weniger vielseitig als GPT-4o mini, aber unschlagbar, wenn es ums Programmieren oder logisches Knobeln unter Budget-Auflagen geht.

Aktuelle Preise: OpenAI o1-mini ist deutlich günstiger als das große o1. Die API-Preise liegen bei etwa 3 € pro 1 Mio. Token Eingabe und 12 € pro 1 Mio. Token Ausgabe. Damit bewegt es sich preislich in der Größenordnung von GPT-4o (etwas höher bei Ausgabe). Wichtig zu wissen: o1-mini war zum Start rund 80% günstiger als o1-preview. OpenAI wollte bewusst ein erschwingliches Modell anbieten, das dennoch fortschrittliche Reasoning-Fähigkeiten bietet. In der ChatGPT-Oberfläche war o1-mini für Plus-Nutzer mit ca. 50 Messages pro Woche freigeschaltet – inzwischen könnten Limits weiter gelockert sein. Für viele Entwickler könnte o1-mini perspektivisch sogar komplett frei zugänglich werden (OpenAI überlegt, o1-mini langfristig allen ChatGPT-Free-Usern bereitzustellen). Aus Unternehmer-Sicht sind die Kosten von o1-mini damit moderat und gut planbar, wenn man dessen Einsatzbereich klar umreißt (z.B. X cent pro ausführlichem Code-Review).

Ideale Anwendungsbereiche: o1-mini findet seinen Sweet Spot, wenn bezahlbare, aber fundierte KI-Unterstützung bei technisch-logischen Aufgaben gefragt ist. Beispiele:

-

Automatisierte Code-Prüfung in Startups: Ein kleines Software-Startup kann o1-mini in seinen Entwicklungsprozess einbinden. Bei jedem Git-Commit könnte das Modell automatisch den neuen Code analysieren, offensichtliche Fehler oder Unsicherheiten anmerken und Verbesserungsvorschläge machen. So bekommt das Team quasi einen zusätzlichen „Junior Developer“, der 24/7 Code reviewt – für wenige Eurocent pro 1000 Zeilen Code.

-

Datengetriebene Entscheidungsfindung: In Bereichen wie Fintech oder Logistik, wo viel mit Zahlen und Optimierungen gearbeitet wird, kann o1-mini helfen, Was-wäre-wenn-Szenarien durchzurechnen. Etwa ein Logistik-Startup lässt o1-mini verschiedene Routenoptimierungen oder Lagerbestückungen durchdenken. Das Modell liefert durch seinen systematischen Ansatz gut begründete Optionen, wie man Prozesse effizienter gestalten kann.

-

Technischer Kundensupport (Second-Level): Während ein GPT-4o mini einfache FAQs beantworten kann, könnte o1-mini zum Einsatz kommen, wenn Kunden sehr technische Fragen stellen. Zum Beispiel in einem Cloud-Software-Unternehmen: Fragt ein Kunde nach der Ursache für einen komplexen API-Fehler, kann o1-mini anhand der Dokumentation und Fehlermeldung eine detaillierte Analyse liefern – fundierter als es ein generisches Modell könnte.

Tipps zur Modellauswahl für Unternehmen

Angesichts dieser Modellvielfalt stellt sich die Frage: Welches ChatGPT-Modell passt zu welchem Unternehmen? Die Wahl hängt von mehreren Faktoren ab – vor allem von der Unternehmensgröße (Budget, Nutzungsvolumen) und der Branche bzw. konkreten Anwendung. Hier einige Empfehlungen:

-

Startups und kleine Unternehmen: Bei begrenztem Budget und kleinem Team empfiehlt es sich, mit den kostenfreien oder günstigsten Optionen zu starten. GPT-4o mini bietet bereits viel Funktionalität für wenig Geld – ideal, um etwa erste Chatbot-Prototypen zu bauen oder tägliche Routineaufgaben zu automatisieren. Für ein Tech-Startup, das viel programmiert, kann auch o1-mini attraktiv sein, um Entwickleraufgaben zu beschleunigen, ohne enorme Kosten zu verursachen. Braucht das kleine Unternehmen gelegentlich hochwertigere Texte (z.B. für Marketing-Material), ist ein ChatGPT-Plus-Abo mit Zugriff auf GPT-4o eine preiswerte Lösung. Kurz gesagt: Erst die „Mini“-Modelle ausschöpfen, punktuell durch GPT-4o ergänzen – und GPT-4.5/o1 nur nutzen, wenn wirklich nötig.

-

Mittelständische Unternehmen: Im Mittelstand sind die Anwendungsfälle meist breiter gefächert – vom Vertrieb über Kundenservice bis zur internen Datenanalyse. Hier lohnt ein Mix der Modelle. GPT-4o kann als Arbeitspferd für viele Aufgaben dienen, da es sehr günstig skaliert und solide Qualität liefert. Für bestimmte Projekte, bei denen Kreativität oder höchste Präzision gefragt sind (z.B. Image-Kampagnen, wichtige Angebotsdokumente), kann man gezielt GPT-4.5 einsetzen – etwa via ChatGPT Pro oder API, je nach Häufigkeit. Branchen mit hohem Technikanteil (Software, Engineering) profitieren zudem enorm von o1: Ein mittelständischer Softwareentwickler könnte z.B. o1 für anspruchsvolle Architektur-Entwürfe oder Fehleranalysen einsetzen, während der Rest der Firma mit GPT-4o generalistische Unterstützung bekommt. Wichtig ist, pro Anwendungsfall das passende Modell zu wählen: z.B. Kundensupport-Chatbot auf 4o mini, Marketing-Team nutzt GPT-4o, Data Science-Team testet o1 für komplexe Analysen. So bleibt das Kosten-Nutzen-Verhältnis optimal.

-

Großunternehmen und Konzerne: Größere Unternehmen können – auch finanziell – aus dem Vollen schöpfen, sollten aber dennoch effizient planen. Für Konzerne mit riesigen Datenmengen und internationalen Geschäften ist GPT-4.5 besonders reizvoll, da es mehrsprachig top-performant ist und lange Berichte/Reports mühelos analysiert. Ein Global Player könnte GPT-4.5 z.B. verwenden, um quartalsweise Marktdaten aus aller Welt zusammenzufassen oder hochwertige mehrsprachige Pressemitteilungen zu verfassen. Gleichzeitig werden Konzerne aber auch stark von den o1-Modellen profitieren: In Forschungs- und Entwicklungsabteilungen, bei der Produktinnovation oder im analytischen Controlling kann o1 sein volles Potenzial entfalten, um komplexe Probleme zu lösen (quasi als KI-Berater auf Nobelpreisträger-Niveau in Mathematik/Tech). Großunternehmen könnten sich sogar eigene interne Tools bauen, die je nach Anfrage automatisch entscheiden, ob GPT-4.5, GPT-4o oder o1 die beste Wahl ist – OpenAI arbeitet an Funktionen, die genau diese Modellorchestrierung ermöglichen. Für Routineaufgaben in großen Stückzahlen (z.B. automatische Antworten im Kundenservice-Center) bleibt GPT-4o mini als günstigste Lösung relevant, um Kosten gering zu halten. Insgesamt gilt: Ein mehrschichtiges KI-Konzept aufbauen – vom günstigen Massenmodell bis zum hochkarätigen Spezialmodell – sodass jeder Unternehmensbereich das für ihn passendste Werkzeug hat.

-

Branchenüberblicke: Auch die Branche beeinflusst die Wahl: Tech- und IT-Unternehmen werden am ehesten zur o1-Serie greifen, um ihre Entwicklungsprozesse zu optimieren. Kreativbranchen und Marketing-Agenturen schätzen GPT-4.5 für dessen herausragende kreative Textfähigkeiten und nutzen GPT-4o, um zusätzlich schnell Bildmaterial zu generieren. E-Commerce und Kundenservice-orientierte Firmen setzen auf GPT-4o/4o mini, um Chatbots und Empfehlungs-Systeme in großem Maßstab zu betreiben. Forschungsintensive Branchen (Gesundheit, Wissenschaft, Finanzen) kombinieren die Modelle: GPT-4.5 für umfassende Literatur-Recherche, o1 für tiefgreifende Analysen, GPT-4o für alltägliche Berichte. Kurz gesagt: Jedes Modell hat seine Nische – je klarer man die Anforderungen der eigenen Branche kennt, desto gezielter kann man das passende KI-Modell wählen.

Fazit: KI-Potenziale für die Zukunft unternehmerischer Prozesse

Die aktuellen ChatGPT-Modelle von OpenAI – GPT-4.5, GPT-4o, GPT-4o mini, OpenAI o1 und o1-mini – zeigen eindrucksvoll, welches Spektrum an Möglichkeiten KI heute schon abdeckt. Vom günstigen Helfer für einfache Aufgaben bis zum hochentwickelten Problemlöser für Spezialfälle ist für jedes Unternehmen etwas dabei. Unternehmer profitieren von diesen Werkzeugen, indem sie Routineprozesse automatisieren, qualitativ hochwertige Inhalte schneller erstellen und komplexe Herausforderungen mit KI-Unterstützung angehen können. Wichtig ist, das richtige Modell für den jeweiligen Zweck auszuwählen und dessen Grenzen zu kennen. Schon jetzt lassen sich Geschäftsprozesse durch klugen KI-Einsatz deutlich effizienter, kreativer und skalierbarer gestalten. In Zukunft dürften sich diese Potenziale noch weiter entfalten – man denke an noch größere Modelle, nahtlose Integration in Arbeitsabläufe und branchenspezifisch trainierte KI-Assistenten. Unternehmen, die heute experimentieren und lernen, die Stärken der verschiedenen ChatGPT-Modelle gezielt einzusetzen, schaffen sich einen Innovationsvorsprung. KI ist kein Allheilmittel, aber die neuesten Modelle von OpenAI sind mächtige Werkzeuge, um die Zukunft unternehmerischer Prozesse proaktiv mitzugestalten. Bleiben Sie neugierig und prüfen Sie, welches dieser Modelle Ihren nächsten Geschäftsschritt beflügeln kann.